20

Oct

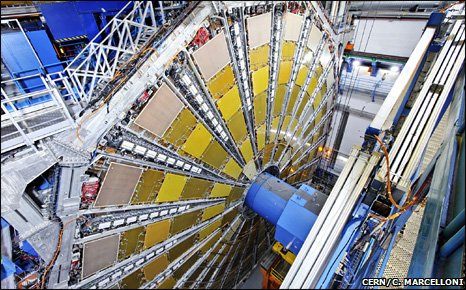

世界最复杂的机器11月重启,温度宇宙最低

By 苏剑林 | 2009-10-20 | 17483位读者 | 引用

30

Oct

最新调查解“毒”珠江:工业水污染触目惊心!

By 苏剑林 | 2009-10-30 | 22986位读者 | 引用

31

Oct

“战神”升空看它到底有多神?

By 苏剑林 | 2009-10-31 | 23776位读者 | 引用

31

Oct

钱学森:人生书写时代

By 苏剑林 | 2009-10-31 | 19592位读者 | 引用

7

Feb

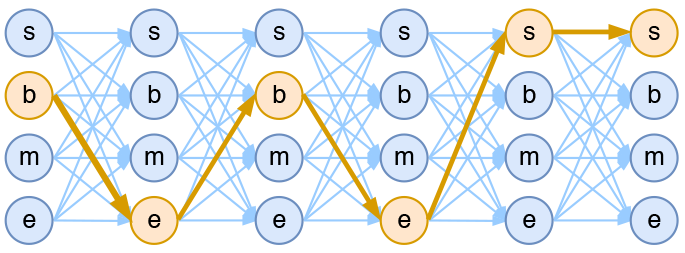

你的CRF层的学习率可能不够大

By 苏剑林 | 2020-02-07 | 112686位读者 | 引用CRF是做序列标注的经典方法,它理论优雅,实际也很有效,如果还不了解CRF的读者欢迎阅读旧作《简明条件随机场CRF介绍(附带纯Keras实现)》。在BERT模型出来之后,也有不少工作探索了BERT+CRF用于序列标注任务的做法。然而,很多实验结果显示(比如论文《BERT Meets Chinese Word Segmentation》)不管是中文分词还是实体识别任务,相比于简单的BERT+Softmax,BERT+CRF似乎并没有带来什么提升,这跟传统的BiLSTM+CRF或CNN+CRF的模型表现并不一样。

这两天给bert4keras增加了用CRF做中文分词的例子(task_sequence_labeling_cws_crf.py),在调试过程中发现了CRF层可能存在学习不充分的问题,进一步做了几个对比实验,结果显示这可能是CRF在BERT中没什么提升的主要原因,遂在此记录一下分析过程,与大家分享。

5

Dec

科学空间:2009年12月重要天象

By 苏剑林 | 2009-12-05 | 24144位读者 | 引用

26

Dec

新年新天象:2010年1月重要天象

By 苏剑林 | 2009-12-26 | 22485位读者 | 引用

31

Dec

最近评论