《环球科学》:超越费曼图

By 苏剑林 | 2012-11-26 | 20751位读者 | 引用虽然文章的大部分内容我都还无法弄懂,但是这里边讲述的振奋人心的内容让我决定把它转载过来。文章说,将大自然的各种力统一起来,或许没有物理学家原来所想的那么困难。

撰文∕ 伯尔尼(Zvi Bern)、狄克森(Lance J. Dixon)寇索尔(David A. Kosower)

翻译∕ 高涌泉(台湾大学物理系教授)

提供/ 科学人(Scientific American繁体中文版)

重点提要

物理学家对于粒子碰撞的了解,最近经历了一场宁静革命。知名物理学家费曼所引入的观念对于很多应用而言已到达极限。作者与合作者已经发展出新的方法。

物理学家利用新方法,可以更可靠地描述在大强子对撞机(LHC)那种极端条件下普通粒子的行为,这将帮助实验学家寻找新粒子与新作用力。

新方法还有更为深刻的应用:它让一种于1980年代被物理学家放弃的统一理论有了新生命,重力看起来像是双份的强核力一起作用。

春天某个晴朗的日子,本文作者狄克森从英国伦敦地铁的茂恩都站进入地铁,想前往希斯洛机场。伦敦地铁每天有300万名乘客,他瞧着其中一位陌生人,无聊地想着:这位老兄会从温布尔登站离开地铁的机率有多大?由于此人可能搭上任何一条地铁路线,所以该如何推算这个机率呢?他想了一会,领悟到这个问题其实跟粒子物理学家所面对的麻烦很像,那就是该如何预测现代高能实验中粒子碰撞的后果。

欧洲核子研究组织(CERN)的大强子对撞机(LHC)是这个时代最重要的探索实验;它让质子以近乎光速前进并相撞,然后研究碰撞后的碎片。我们知道建造对撞机及侦测器得用上最尖端的技术,然而较不为人知的是,解释侦测器的发现同样也是极为困难的挑战。乍看之下,它不应该那么困难才对,因为基本粒子的标准模型早已确立,理论学家也一直用此模型来预测实验的结果,而且理论预测所依赖的是著名物理学家费曼(Richard P. Feynman)早在60多年前就发展出来的计算技巧,每位粒子物理学家在研究生阶段都学过费曼的技巧;关于粒子物理的每本科普书、每篇科普文章,也都借用了费曼的概念。

《新理解矩阵4》:相似矩阵的那些事儿

By 苏剑林 | 2012-11-11 | 58777位读者 | 引用这篇文章估计是这个系列最后一篇了,也许以后会继续谈到线性代数,但是将会独立开来讲述。本文主要讲的是相似矩阵的一些事情,本文的观点很是粗糙,自己感觉都有点模糊,因此请读者细细阅读。在孟岩的文章里头,它对矩阵及其相似有了一个非常精彩的描述:

“矩阵是线性空间中的线性变换的一个描述。在一个线性空间中,只要我们选定一组基,那么对于任何一个线性变换,都能够用一个确定的矩阵来加以描述。”

同样的,对于一个线性变换,只要你选定一组基,那么就可以找到一个矩阵来描述这个线性变换。换一组基,就得到一个不同的矩阵。所有这些矩阵都是这同一个线性变换的描述,但又都不是线性变换本身。

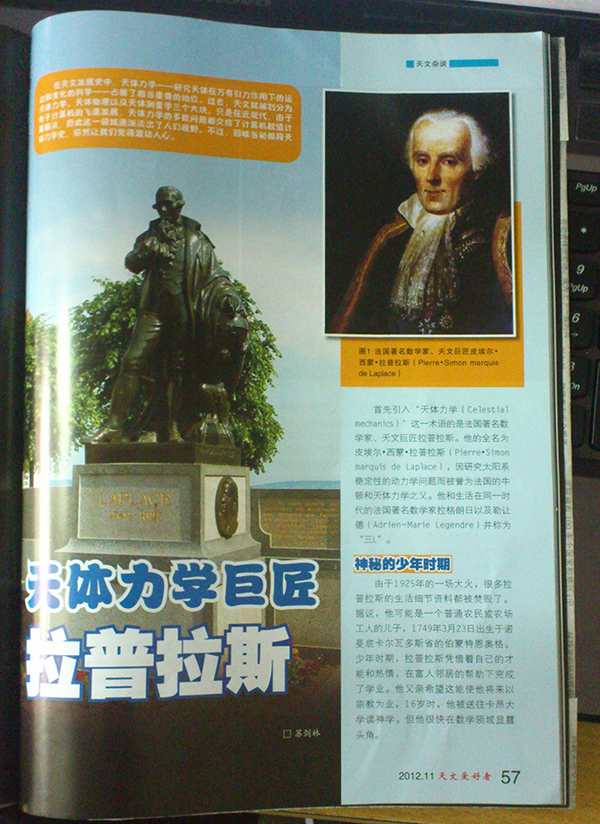

天体力学巨匠——拉普拉斯

By 苏剑林 | 2012-11-16 | 49339位读者 | 引用本文其实好几个月前就已经写好了,讲的是我最感兴趣的天体力学领域的故事,已经发表在2012年11月的《天文爱好者》上。

作为一本天文科普杂志,《天文爱好者》着眼于普及天文,内容偏向于有趣的天体物理等,比较少涉及到天体力学。事实上,在天文发展史中,天体力学——研究天体纯粹在万有引力作用下演化的科学——占据了相当重要的地位。过去,天文就被划分为天体力学、天体物理以及天体测量学三个大块。只是在近现代,由于电子计算机的飞速发展,天体力学的多数问题都交给了计算机数值计算解决,因此这一领域逐渐淡出了人们视野。不过,回味当初那段天体力学史,依然让我们觉得激动人心。

首先引入“天体力学(Celestial mechanics)”这一术语的是法国著名数学家、天文巨匠拉普拉斯。他的全名为皮埃尔?西蒙?拉普拉斯(Pierre?Simon marquis de Laplace),因研究太阳系稳定性的动力学问题被誉为法国的牛顿和天体力学之父。他和生活在同一时代的法国著名数学家拉格朗日以及勒让德(Adrien-Marie Legendre)并称为“三L”。

神秘的少年时期

由于1925年的一场大火,很多拉普拉斯的生活细节资料都丢失了。根据W. W. Rouse Ball的说法,他可能是一个普通农民或农场工人的儿子,1749年3月23日出生于诺曼底卡尔瓦多斯省的伯蒙特恩奥格。少年时期,拉普拉斯凭借着自己的才能和热情,在富人邻居的帮助下完成了学业。他父亲希望这能使他将来以宗教为业,16岁时,他被送往卡昂大学读神学。但他很快在数学上显露头角。

矩阵化简二次型(无穷小近似处理抛物型)

By 苏剑林 | 2012-12-25 | 26052位读者 | 引用(阅读本文最好有一定的线性代数基础,至少对线性代数里边的基本概念有所了解。)

这学期已经接近尾声了,我们的《解析几何》已经讲到化简二次曲线了。可是,对于没有线性代数的其他同学们,直接用转轴和移轴这个计算公式来变换,那计算量会让我们很崩溃的;虽然那个“不变量”方法计算上有些简单,却总让人感到很诡异,总觉得不知从何而来,而且又要记一堆公式。事实上,如果有线性代数的基础,这些东西变得相当好理解的。我追求用统一的方法求解同一种问题,即用统一的方式处理所有的二次型,当然也希望计算量简单一点。

一般的模型

一般的二次型可以写成

$$x^T A x + 2 b^T x + c=0$$

其中$x,b$都是n维列向量(各元素为$x_i$和$b_i$),A是n阶方阵(各元素为$a_{ij}$),c是常数。在这里,我们只讨论n=2和n=3的情况。化简二次型的过程,可以归结为A矩阵的简化。

轻微的扰动——摄动法简介(1)

By 苏剑林 | 2013-01-16 | 49791位读者 | 引用为了计算实际问题,我们总会采用各种各样的理想模型。一般而言,一个模型越接近实际现象,它往往会越复杂。而忽略掉多数微小的干扰,只保留一些主要的项,这通常可以得到一个相当简单、能够精确解出的模型。以这样的一个可以精确解出的近似模型为基础,逐渐地把微小项的影响添加进去,使得我们的答案越来越准确,这就是摄动法的思想,也称作“微扰理论”。这种方法源于求解天体力学的N体问题,而现在已经发展成为一门相当系统的学科,并应用到了相对多的领域,如量子力学、电子理论等。

其实不难发现,实际问题中存在不少这样的例子,即当我们要计算某个现象时,先考虑最突出的,然后再考虑细节。比如说,要计算地球的轨道,先把它看成一个与太阳组成的纯粹的二体系统,然后把各种微小效应加进去,比如月球的影响、各大行星的影响甚至由于地球的不规则形状所产生的影响等。当然,不仅仅是这一类复杂的“大问题”,我们平常可能会遇到的一些“小问题”有可能也让摄动法派上用场。本文试图将摄动法介绍给各位读者。

摄动法的主要步骤是先忽略微小影响(令小参数为0),求出精确解;然后把所要求的解表达为关于小参数的幂级数。这个方法可以用于解答代数方程、微分方程等等各种领域。下面先以一个简单的代数方程来说明:

一、求解方程:$\varepsilon x^3+x^2=p^2$

新科学家:割裂时间空间,统一相对论量子论

By 苏剑林 | 2013-01-16 | 29282位读者 | 引用这篇文章源于《新科学家》2010年8月7日刊,它介绍了物理学家Horava为了统一相对论和量子力学,把广义相对论的时空联系割裂的尝试。在相对论中,时间和空间结合成了不可分割的整体。而现在,有物理学家却要把时间与空间分开,来建立让广义相对论和量子力学相调和的统一理论。我对这个理论挺感兴趣的,当然,我还没有能力弄懂它。只是它符合了我们大多数人的一个直觉,就是时间总有跟空间不同的地方,它们之间不应该完全等同起来。不过,事实如何,只有未来的实验能够严重了。

本文并没有官方的中文译文,现载的译文来自“译言网”。译文有一些翻译不大正当的地方,由于时间限制,无法一一修正,但是我觉得对于理解本文内容已经足够了。如果有疑问,不妨参考后边的英文原文,并在此提出与大家讨论。

对爱因斯坦的反思:空间-时间耦合的物理数学的终结

纠结于融合引力和量子力学的物理学家们正向着一个受到铅笔芯启发的理论欢呼雀跃,这个理论可以很简单地让他们取得成功。

它曾是一个改变了我们思考空间和时间的方式的报告。那一年是1908年,德国数学家赫尔曼-闵可夫斯基正尝试着理解爱因斯坦火热的新思想——即我们现在所熟知的狭义相对论,它描述当物质运动很快时它们是如何收缩以及时间是如何扭曲的。“从此独立的空间和时间将注定淡出到纯粹的虚幻中,”闵可夫斯基说道:“而只有两者的统一才能保证一个独立的现实世界。”

高斯型积分的微扰展开(二)

By 苏剑林 | 2015-03-07 | 24317位读者 | 引用为什么第二篇姗姗来迟?

其实要写这系列之前,我已经构思好了接下来几篇的内容,本来想要自信地介绍自己想到的一些积分展开的技巧;而且摄动法我本身就比较熟悉,所以正常来说不会这么迟才有第二篇。然而,在我写完第一篇,准备写第二篇的期间,我看到了知乎上的这篇回复:

http://www.zhihu.com/question/24735673

这篇文章大大地拓展了我对级数的认识。里边谈及到了积分的展开是一个渐近级数。这让我犹豫了,怀疑这系列有没有价值,因为渐近级数意味着不管怎样的展开技巧,得到的级数收敛半径都是0。

后来再想想,就算是渐近级数,也有改进的空间,有加速收敛的方法,所以我想我这几篇文章,应该还有一点点意义吧,还可以顺便介绍一下渐近级数和奇点的相关理论。嗯,就这么办吧。

这已经是去年写的稿件了,刊登在今年二月份的《天文爱好者》上,本文的标题还登载了该期天爱的封面上,当时甚是高兴呢!在此与大家分享、共勉。

相信许多天文爱好者都知道第一、第二、第三宇宙速度的概念,也会有不少的天爱自己动手计算过它们。我们道,只要发射速度达到7.9km/s,宇宙飞船就可以绕地球运行了;超过11.2km/s,就可以抛开地球,成为太阳系的一颗“人造行星”;再大一点,超过16.7km/s,那么就连太阳也甩掉了,直奔深空。

16.7km/s,咋看上去并不大,因为地球绕太阳运行的速度已经是30km/s了,这个速度在宇宙中实在是太普通了。但是对于我们目前的技术来说,它大得有点可怕。维基百科上的资料显示,史上最强劲的火箭土星五号在运送阿波罗11号到月球时,飞船最终也只能加速到接近逃逸速度,即11.2km/s,而事实上第三宇宙速度已经是是目前人造飞行器的速度极限了。可是没有速度,我们就不能发射探测器去探索深空,那些科幻小说中的“星际移民”,就永远只能停留在小说上了。

最近评论